Slavoj Žižek does not care about surveillance:

Archiv der Kategorie: Spackeria

Digitaler Umweltschutz?

In der Süddeutschen fordert Adrian Lobe einen digitalen Umweltschutz und argumentiert dabei mit Datenemissionen. Das ist mir im Ansatz sympathisch, weil ich die Vorstellung der permanenten Datenemission für ein geeigneteres Modell der heutigen Datenverarbeitung halte. Andererseits geht mir jedoch seine Ausweitung des Gedankens auf eine Analogie zu Emissionen im Sinne des Umweltschutzes zu weit.

Unabhängig davon, was wir insgesamt von der personenbezogenen Datenverarbeitung halten und welche Schutzziele wir im Einzelnen verfolgen, brauchen wir als Grundlage ein passendes Modell davon, wie Daten entstehen, fließen und verarbeitet werden. In dieser Hinsicht beschreibt das Emissionsmodell die heutige Realität besser als die Begriffe des traditionellen Datenschutzes, die auf das Verarbeitungsparadigma isolierter Datenbanken gemünzt sind.

Der klassische Datenschutz in der Tradition des BDSG (alt) ist begrifflich und konzeptionell eng an die elektronische Datenverarbeitung in isolierten Datenbanken angelehnt. Daten werden „erhoben“ (jemand füllt ein Formular aus) und sodann „verarbeitet“, das heißt gespeichert, verändert, übermittelt gesperrt oder gelöscht, sowie vielleicht sogar „genutzt“ (diesen Begriff verfeinert das alte BDSG nicht weiter).

Diese Vorstellungen passen nicht zu einer Welt, in der jeder ein Smartphone in der Tasche hat, das permanent Daten in die Cloud sendet. Sie passen nicht einmal dazu, dass einer die Adresse und Telefonnummer eines anderen in der Cloud speichert. Aus dem Konflikt zwischen der veralteten Vorstellung und der heutigen Realität resultieren regelmäßig Blüten wie der Hinweis des Thüringer Datenschutzbeauftragten, die Nutzung von WhatsApp sei rechtswidrig, die den Datenschutz als realitätsfern dastehen lassen.

Mit dem Emissionsmodell bekommen wir eine neue Diskussionsgrundlage, die näher an der tatsächlichen Funktionsweise der Datentechnik liegt. Wenn wir die Schutzziele des Datenschutzes auf dieser Grundlage diskutieren, finden wir eher praktikable und wirksame Maßnahmen als auf der Basis veralteter Vorstellungen. Das ist die positive Seite des Emissionsgedankens.

Die negative Seite zeigt sich, wenn man den Gedanken zu weit treibt und daraus eine Analogie zu Emissionen im Sinne des Umweltschutzes macht. Das ist zwar verführerisch – wenn ich mich richtig erinnere, haben wir diese Frage beim Schreiben von „Emission statt Transaktion“ auch diskutiert – aber ein rückwärtsgewandter Irrweg.

Ein entscheidender Unterschied zwischen Umwelt- und Datenemissionen liegt darin, dass Umweltemissionen eine zwangsläufige Wirkung haben: Im verschmutzten Fluss sterben die Fische, Kohlendioxid ändert das Klima und Plutonium im Tee macht krank. Nach der Freisetzung lässt sich die Wirkung nur noch durch eine – meist aufwändige – Sanierung steuern und unter Umständen nicht einmal das.

Daten haben diese zwangsläufige Wirkung nicht. Wie wir miteinander und wie Organisationen mit uns umgehen, können wir unabhängig von Daten regeln. Wenn wir zum Beispiel Diskriminierung verbieten und dieses Verbot wirksam durchsetzen, dann kommt es auf die verwendeten Mittel nicht mehr an – was eine Organisation weiß, ist egal, denn sie darf damit nichts anfangen.

Dem traditionellen Datenschutz ist diese Perspektive jedoch fremd, denn er verfolgt das Vorsorgeprinzip für den Umgang mit epistemischen Risiken: Wenn wir die Gefahren von etwas noch nicht gut genug verstehen, um sie quantifizieren zu können, lassen wir besser sehr große Vorsicht walten. Dieser Gedanke ist im Umweltschutz weit verbreitet und bezieht seine Berechtigung dort aus dem Maximalschadenszenario der Zerstörung unserer Lebensgrundlage. Selbst mit dieser Drohung im Gepäck bleibt das Vorsorgeprinzip freilich umstritten, denn epistemische Ungewissheit über Gefahren impliziert auch Ungewissheit über die Kosten und Auswirkungen von Vorsichtsmaßnahmen.

Im traditionellen Datenschutz – der, ob Zufall oder nicht, etwa zeitgleich mit dem Erstarken der Umwelt- und Anti-Atomkraft-Bewegung entstand – finden wir diesen Vorsorgegedanken an mehreren Stellen: in der Warnung des Bundesverfassungsgerichts im Volkszählungsurteil vor einer Gesellschafts- und Rechtsordnung, „in der Bürger nicht mehr wissen können, wer was wann und bei welcher Gelegenheit über sie weiß“, im grundsätzlichen Verbot der Verarbeitung personenbezogener Daten, das nur ausnahmsweise durch eine Rechtsvorschrift oder die Erlaubnis der Betroffenen aufgehoben werde, sowie in der Forderung nach Datenvermeidung und Datensparsamkeit.

All dem liegt die Vorstellung zugrunde, die Speicherung und Verarbeitung personenbezogener Daten sei mit unschätzbaren Gefahren verbunden und daher nur äußerst vorsichtig zu betreiben. Allerdings wissen wir heute, dass man damals so manche Gefahr grob überschätzte. So warnte das Verfassungsgericht weiter: „Wer unsicher ist, ob abweichende Verhaltensweisen jederzeit notiert und als Information dauerhaft gespeichert, verwendet oder weitergegeben werden, wird versuchen, nicht durch solche Verhaltensweisen aufzufallen“, und: „Freie Entfaltung der Persönlichkeit setzt unter den modernen Bedingungen der Datenverarbeitung den Schutz des Einzelnen gegen unbegrenzte Erhebung, Speicherung, Verwendung und Weitergabe seiner persönlichen Daten voraus.“ Das war zu kurz gedacht – heute zelebrieren viele von uns ihre abweichenden Verhaltensweisen in der Öffentlichkeit von Twitter, Facebook, Instagram und YouTube und träumen dabei von einer Karriere als Influencer.

Heute leben wir in jener Welt, vor der das Verfassungsgericht einst warnte, genießen ihren großen Nutzen und spüren nur geringe Schmerzen. Von den befürchteten Gefahren für die freie Entfaltung er Persönlichkeit ist wenig zu sehen. Zudem können wir inzwischen ganz gut einschätzen, welche Gefahren bestehen und was man dagegen zu welchem Preis tun kann. Der Vorsorgegedanke ist damit überholt und deshalb passt die Analogie zum Umweltschutz nicht so gut. Andererseits ist der Umweltschutz nicht nur Vorsorge, sondern beinhaltet auch die risikoorientierte Gefahrenabwehr und in dieser Hinsicht mag man sich an ihm als Vorbild orientieren.

Komplette Durchleuchtung?

Der klassische Datenschutz europäischer und insbesondere deutscher Prägung geht von einem Vorurteil aus: Das Speichern und Verarbeiten personenbezogener Daten sei gefährlich und die Gefahr wachse proportional mit der Datenmenge pro Person. Folgerichtig bleiben diese gefährlichen Handlungen verboten, solange sie nicht eine Einwilligung des Betroffenen oder ein Gesetz erlaubt.

Max Schrems, Initiator von Europe vs. Facebook und derjenige, der von Facebook Auskunft über seine dort gespeicherten Daten erstritt, hat ein Buch geschrieben, Kämpf um deine Daten. Die zugehörige Rezension der FAZ illustriert die Datenschutz-Prämisse und wie sie unsere Wahrnehmung beeinflusst:

»Ein anderer Slogan der Digitalwirtschaft lautet: „Wir machen doch alles nur, um die Werbung auf den Nutzer zuzuschneiden.“ Dem hält Schrems entgegen, dass personalisierte Werbung längst nicht so effektiv ist, wie alle tun. Werbetreibende erzählten das hinter vorgehaltener Hand. Die komplette Durchleuchtung des Nutzers geschehe im Grunde bloß für ein paar lausige Klicks mehr, resümiert Schrems. Nur wegen Cent-Beträgen wird unser Grundrecht auf Datenschutz aufgelöst.«

Die komplette Durchleuchtung aus nichtigem Anlass, anders kann man es kaum sehen, wenn man die Grundannahme des Datenschutzes akzeptiert. Tut man dies nicht, so bietet sich eine alternative Interpretation an: Was die Datenkraken über uns wissen und vorhersagen können, genügt gerade mal, um die Werbeklickraten ein wenig zu erhöhen. Von Algorithmen, die uns besser kennen als wir selbst, kann keine Rede sein. Personalisierte Werbung ist weit davon entfernt, uns genau das vorzulegen, was wir sicher anklicken werden. Darüber liefert der Einzelne nämlich viel zu wenig Informationen. „Personalisierte“ Werbung ist in Wirklichkeit statistisch optimierte Werbung, der die Zielgruppensegmentierung und -zuordnung ein wenig besser gelingt als den extrem groben klassischen Mechanismen. Mit herkömmlichen Methoden bekomme ich Autowerbung, wenn ich eine Autozeitschrift lese und Nerdwerbung auf Slashdot. Moderne Verfahren nutzen vielfältigere Merkmale und finden die optimale Auswahlstrategie zum Teil selbst.

Viel mehr als eine etwas genauere Zielgruppensegmentierung steckt nicht hinter der personalisierten Werbung, und die meisten Anzeigen werden nach wie vor ignoriert. Statt von der kompletten Durchleuchtung für ein paar Cent sollte man besser von Optimierungen am Rande der Aufmerksamkeit sprechen. Ist das gefährlich, schädlich, manipulativ? Eher nicht, jedenfalls nicht mehr als Werbung an sich schon ist. Lebe ich besser, wenn ich sorgfältig jede Datenspur vermeide? Nicht messbar. Diese pragmatische, risikoorientierte Sicht ist dem klassischen Datenschutz fremd.

P.S. (2014-06-14): Kristian Köhntopp erklärt passend dazu, warum verschiedene Formen der Durchleuchtung unterschiedlich nützlich sind.

Denkverbote für Star-Trek-Computer?

Zwei Jahre nach Datenkrake Google ist aus den damals noch unscharfen Gedanken mit Unterstützung meiner Kolleginnen Annika Selzer, Andreas Poller und Mark Bedner ein Artikel geworden: Denkverbote für Star-Trek-Computer?, Datenschutz und Datensicherheit – DuD 38(1), Januar 2014, DOI: 10.1007/s11623-014-0008-x. Abgeschlossen ist das Thema damit nicht, die Diskussion geht gerade erst richtig los.

Vor 30 Jahren definierte das Bundesverfassungsgericht im Volkszählungsurteil das Recht auf informationelle Selbstbestimmung und erklärte es zu einer Voraussetzung für Freiheit und Gemeinwohl. Die elektronische Datenverarbeitung (EDV), so nannte man die Informationstechnik damals, steckte noch tief im Manufakturzeitalter. Datenbanken ersetzten gerade die Karteischränke, das beschriebene und sortierte Papier. Wissenschaftler begannen, über künstliche Intelligenz nachzudenken, aber das war eine Zukunftsvision; der Spielfilm Computer Chess fängt die Stimmung jener Zeit ein.

Einerseits zeugt das Volkszählungsurteil von Weitsicht. Aus der Datenmanufaktur ist eine Datenindustrie geworden. Computer spielen heute nicht nur Schach auf Weltmeisterniveau, sie gewinnen auch im Fernsehquiz Jeopardy! Amazon, Netflix, Last.fm und viele andere Dienste empfehlen uns, was unserem Geschmack entspricht, und liegen damit häufig genug richtig um uns erfolgreich etwas zu verkaufen. Google ermittelt aus Suchanfragen die Ausbreitung von Grippewellen, wenn auch nicht ganz genau. Das Thema Datensammlung und Datenverarbeitung grundsätzlich anzugehen erweist sich im Nachhinein als richtig.

Wohlfeile Empfehlungen

Ungefähr einmal pro Woche rät man uns zur Abkehr von einem beliebten Dienst und empfiehlt uns Nischenanbieter als Alternativen. Die Begründung: Sicherheit und Datenschutz. Die tatsächlichen Reaktionen bleiben vorhersehbar verhalten und nächste Woche geht es mit neuem Anlass wieder los. Was soll das?

Offenkundig gehen diese Ratschläge an der Realität vorbei. Auf einem funktionierenden Markt ist niemand erfolgreich von Gottes Gnaden. Nachfrager entscheiden, welche Angebote ihre Bedürfnisse am besten erfüllen. Die meisten Nutzer und Kunden hat derjenige, der die Bedürfnisse der breiten Masse ausreichend gut erfüllt. Er verliert seine Rolle, wenn ein anderer das besser tut; er verliert sie nicht, wenn sich daneben ein Nischenanbieter auf eine kleine Gruppe mit besonderen Bedürfnissen spezialisiert.

Dass viele Menschen zum Beispiel Google, Facebook oder WhatsApp nutzen, hat handfeste Gründe, die man untersuchen und erklären kann. Die Marktpositionen dieser Firmen und Dienste sind nur das Resultat. (Sie können sich auch schnell ändern. Erinnert sich noch jemand an Lycos, Altavista, Yahoo, Nokia, MySpace oder StudiVZ?) Sicherheit und Datenschutz sind dabei bereits eingepreist: Wer ein Angebot auswählt, weil es am besten zu seinen Präferenzen passt, wählt alle anderen ab, die dazu weniger gut passen. Ihm die abgewählten Alternativen noch einmal aufzuzählen und einen bereits in die Wahl eingeflossenen Aspekt herauszustreichen, wird die Entscheidung selten ändern.

Warum tun sie’s dennoch immer wieder und empfehlen uns, was wir bereits zurückgewiesen haben? Weil der Nachrichtenmarkt so etwas kauft. Wer auf sich aufmerksam machen möchte, muss Material liefern, mit dem Medien etwas anfangen können. Unabhängige Expertenempfehlungen sind gut, die kann jeder guten Gewissens verbreiten und sie sind auf diesem Niveau auch nicht schwer zu geben. Das Versprechen von mehr Sicherheit und Datenschutz ist noch besser, denn dieses Versprechen lässt sich kurzfristig kaum wiederlegen.

Vielleicht tun sie’s auch, weil sie am Ende vom ständigen Scheitern profitieren. Was wären die Mahner und Aktivisten, wenn alle ihren Ratschlägen folgten?

P.S.

Nico Lumma über Die Sache mit der hilflosen Datenschutzhysterie.

Afraid of the Intercloud

»Ok, help me understand. Why is #Google buying #Nest seen as bad for privacy/data control/etc.?

I don’t get it, the data Google already has about individuals is better. Is it because Google is seen tied to objects that just exist around us (and are not our direct extensions such as smartphones)? Is it the usual underspecified feeling of „creepyness“?«

I went for the creepiness option. This is my reply, which I recycle here:

Maybe it’s because we’re mentally still living in the pre-cloud and in the database paradigm. Google represents like no other organization – maybe except the NSA – a technological progress that’s hard to grasp. We have no appropriate conception of information risk and risk management for a world in which a single organization can process various data about the wealthier half of the planet’s population and draw inferences from these data. Google represents this development, working at its forefront and pushing the limits.

We have no intuition what may, could, or will happen to us in the long run due to this new technology, and we have no idea ho to manage the risks (or non-risks) that we don’t understand. In a way we are in a similar situation as those who drafted our first data protection laws back in the seventies and early eighties: having to manage not only the uncertainty inherent in any risk consideration, but rather an uncertainty about the uncertainty. Back then, the tentative conceptual and legal solution was to ban all storing and processing of personally identifiable data and grant permission only on a case-by-case basis.

Progress has turned this approach into a delusion, but we lack a convincing replacement. We don’t know what’s risky and what isn’t; most of us don’t even understand what creates value in an Internet-scale data processing business. We project all our uncertainties on the pioneers.

P.S.: Just while I was writing this, the following quote appeared in my G+ stream:

»The desire for security and the feeling of insecurity are the same thing. To hold your breath is to lose your breath. A society based on the quest for security is nothing but a breath-retention contest in which everyone is as taut as a drum and as purple as a beet.«

— Alan Watts

Morgen kann vielleicht etwas passieren

»Ich will jedenfalls auf dieses Problem aufmerksam machen: Sicherheitsbedürfnisse sind strukturell unstillbar. Es ist gegen das Argument ‚Morgen kann vielleicht etwas passieren‘ kein Kraut gewachsen.«

— Winfried Hassemer im Streitgespräch mit Wolfgang Schäuble (via Telepolis)

Zu kurz gedacht wäre allerdings, dies – und die Schlussfolgerung, dass man Grenzen setzen müsse – nur auf staatliche Sicherheitsgesetze, -behörden und -projekte zu beziehen. Der Satz gilt in alle Richtungen und für alle Sicherheitsbedürfnisse, also auch zum Beispiel für den Ruf nach mehr Datenschutz, mehr Verschlüsselung, weniger NSA und so weiter.

Morgen kann vielleicht etwas passieren. Das ist kein ausreichender Grund, auf Segnungen des Internet-Zeitalters zu verzichten, auch wenn sie Google, Facebook oder Cloud Computing heißen. Es ist nicht mal ein ausreichender Grund, sich anders zu verhalten und etwa amerikanische Dienstleister zu meiden, öfter zu verschlüsseln oder Datenpakete anders zu routen.

Morgen kann vielleicht etwas passieren. Etwas dagegen zu tun lohnt sich nur, wenn man sein individuelles Risiko nennenswert reduziert und der Aufwand im Verhältnis zur Risikoreduktion steht. Deswegen erlaube ich mir, die Snowden-Enthüllungen mit Interesse zur Kenntnis zu nehmen, in meinem alltäglichen Verhalten aber nicht weiter darauf zu reagieren. Ich habe keinerlei Anhaltspunkte dafür, dass die NSA mein Leben beeinflusst, folglich lohnt es sich auch nicht, individuelle Maßnahmen zu ergreifen.

Post-privacy is for everyone

Two quotes and a thought:

»If you have something that you don’t want anyone to know, maybe you shouldn’t be doing it in the first place.« — Eric Schmidt

»A public or private organization’s best defense against whistle-blowers is to refrain from doing things it doesn’t want to read about on the front page of the newspaper.« — Bruce Schneier

Is their message the same, or does it make a difference whether we talk about individuals or organizations? One limitation they surely have in common: just that one doesn’t want others to know certain things does not imply these things are wrong, even if one rightfully fears the others‘ reaction. Both quotes oversimplify the problem by ignoring the right/wrong dimension, thus omitting case discriminations that may be important to the discussion.

Hände weg von Ostwind: Was Herr Weichert vom Wetterbericht lernen kann

Das Wetter passiert einfach und wir passen uns an, damit es uns wenig beeinträchtigt. Meteorologen helfen uns dabei, indem sie das Wetter beobachten und uns Berichte und Vorhersagen liefern. So weiß ich heute schon, ob ich morgen mit dem Fahrrad zur Arbeit fahren möchte oder lieber nicht, und der Kollege vom THW kann einschätzen, ob er morgen zur Arbeit fährt oder mit Sandsäcken zum Deich. Datenschützer versuchen, anders zu orbeiten, doch das ergibt keinen Sinn.

Dem Gesetz nach ist der Datenschutz präventiv: personenbezogene Daten zu verarbeiten ist erst einmal verboten, solange nicht eine Reihe von Anforderungen erfüllt sind. In der Karteikarten-IT der 70er, in der er seine Wurzeln hat, war das kein Problem. Damals gab es noch kein Internet mit emergenten Diensten für Milliarden von Nutzern, experimenteller Softwareentwicklung im Produktivbetrieb, mit sozialen Graphen und statistischen Inferenzmodellen über große Datenmengen. Als riskant galt die damals noch junge elektronische Datenverarbeitung als solche, der man folglich personenbezogene Daten nur bedingt und kontrolliert zugänglich machen wollte.

Dem Internet konsequent Daten vorzuenthalten, ist heute weder praktikabel noch nützlich: nicht praktikabel, weil das Internet nichts anderes tut als Daten zur Verarbeitung an einen anderen Ort zu transportieren, und nicht nützlich, weil übertriebene Datensparsamkeit das persönliche Lebensrisikoprofil nur geringfügig beeinflusst. Umfang und Vielfalt der Datenverarbeitung laufen der bedächtigen Abwägung von Nutzen und Risiken in immer schnelleren Schritten davon – ohne dass wir deswegen alle stürben.

An die bloße Tatsache, dass Daten anfallen und genutzt werden, können wir unser Risikomanagement nicht mehr anknüpfen, sonst würden wir uns zu oft und zu lange mit Irrelevantem beschäftigen. Stattdessen müssen wir schnell und effizient tatsächliche Risiken identifizieren, den Rest vorerst ignorieren und Einschätzungsfehler später erkennen und behandeln. Das wäre ein beobachtender, risikoorientierter Datenschutz, der die Verarbeitung personenbezogener Daten grundsätzlich als gegeben hinnimmt und – abgesehen von einigen Grundregeln zur Abwicklung – nur dort eingreift, wo sich besondere Risiken zeigen.

Datenverarbeitung im Internet findet wie das Wetter einfach statt und lässt sich nur begrenzt beeinflussen oder gar verbieten. Wo sie uns stark beeinträchtigt, müssen wir etwas tun (oder lassen). Überall sonst können wir sie einfach hinnehmen.

In ihrer Öffentlichkeitsarbeit gehen prominente Datenschützer längst reaktiv vor: je offensiver die Facebooks und Googles dieser Welt eine Neuerung bewerben, desto lauter werden auch die amtlichen Warnungen. Der Ansatz ist richtig, aber fehlerhaft umgesetzt. Risikoorientierte Reaktionen müssen dort ansetzen, wo sich relevante und beeinflussbare Risiken empirisch zeigen. Wir haben keine Anhaltspunkte dafür, dass die PR bekannter Internet-Unternehmen mit diesen Risiken korreliert ist und sich als Auslöser für Datenschutzreaktionen gut eignet. Im Gegenteil, wir bekommen vom immer dieselbe Information: Hier ist etwas neu, seht Euch vor!

Man stelle sich vor, Wettervorhersagen gäbe es nur bei Ostwind sowie bei Sprühregen, und jedesmal erklärte uns ein Wetterbeauftragter, welche Gefahren das Wetter so mit sich bringt. Solche Wetterberichte wären nutzlos, sie kämen zur falschen Zeit und mit dem falschen Inhalt. Datenschützer informieren mich an zufälligen Zeitpunkten über allgemeine Gefahrensvisionen. Damit kann ich nichts anfangen.

Anstelle solcher Nachrichten vom Redundanzbeauftragten bekäme ich gerne eine Risikobewertung für mein Nutzungsprofil. Was droht mir voraussichtlich, wenn ich das Internet so nutze, wie ich es eben tue? Wie groß ist das Risiko absolut und im Vergleich? Welche Entscheidungsoptionen haben den größten Einfluss auf meine Risiken? Welche Risiken sind hoch, ohne dass ich sie beeinflussen kann? Statt nachrichtengetriggert immer denselben Teufel an die Wand zu malen, der in meinem Alltag keine Entsprechung findet, könnten sich Datenschützer nützlich machen, indem sie mir regelmäßig fundierte Bewertungen liefern, die ich auf mich und mein Tun beziehen kann.

Meteorologen informieren mich heute darüber, mit welchen Bedingungen ich morgen zu rechnen habe. Manchmal warnen sie auch; dann haben sie dafür einen Anlass und sie stufen ihre Warnung je nach Risiko ab. Diese Art der regelmäßigen Information ist nützlich für mich. Als Grundlage meiner informationellen Selbstbestimmung benötige ich ähnliche Nachrichten. Ich möchte wissen, wie sich einige grundlegende Parameter voraussichtlich entwickeln, um mich darauf einstellen zu können. Warnungen und besondere Unterstützung brauche ich nur im Ausnahmefall; dann, und nicht bei Sprühregen oder Ostwind, darf von mir aus gerne das Cyber-THW mit Datensandsäcken anrücken.

Tracking und Targeting

In ihrem Paper Targeted, Not Tracked: Client-side Solutions for Privacy-Friendly Behavioral Advertising (HotPETS’11) machen Mikhail Bilenko, Matthew Richardson und Janice Y. Tsai auf eine verbreitete Begriffsunsauberkeit in öffentlichen Datenschutzdebatten aufmerksam. Sie diskutieren den Unterschied zwischen dem Targeting als Zweck und dem Tracking als Mittel, den ich vor einiger Zeit hier in der Serie Datenkrake Google behandelt habe.

Tracking ist das, wovor alle Angst haben: jemand sammelt quer durchs Internet individualisierte Daten über das Nutzerverhalten. Daraus entsteht eine große, unheimliche Datenhalde aus detaillierten Informationen über jeden von uns, mit der man alles Mögliche anstellen könnte. Isoliert betrachtet ergibt dieses Tracking jedoch als Geschäftsmodell wenig Sinn:

- Sammle detaillierte Verhaltensdaten über alle

- ???

- Profit!

Viel Sinn ergibt hingegen das Targeting von Werbung, um das Kosten-Nutzen-Verhältnis der Werbetreibenden zu optimieren. Targeting ist, was die Werbewirtschaft in erster Linie möchte. Tracking stellt ein mögliches Mittel zu diesem Zweck dar und ist übrigens nur so effektiv wie die Modelle, mit denen man aus den vorhandenen Daten Entscheidungen ableitet.

Tracking kann ein Mittel zu allen möglichen Zwecken sein. Targeting ist nicht zwingend auf bedrohliches Tracking angewiesen.

Datenschutz: Anforderung oder Spezifikation?

In der Diskussion um die Datenkrake Google fällt mir immer wieder eine begriffliche Ungenauigkeit auf. Datenschutz sei gut und nützlich und bewährt, wie könne man nur dagegen sein, so die Argumentation. Tatsächlich bin ich gar nicht gegen Datenschutz als Anfoderung, sondern ich halte einige Aspekte der gegenwärtigen Spezifikation für ungeignet, die Anforderungen zu erfüllen.

Was ist der Unterschied zwischen Anforderungen und Spezifikationen? Anforderungen beschreiben die Ziele, die man verfolgt. Spezifikationen beschreiben den Weg. Charles B. Haley erklärt den Unterschied so:

»The distinction between requirement and specification is an important one. A requirement does not describe how a system is to be implemented, but instead describes what is desired by the stakeholders in terms of phenomena visible at certain domains in the real world. It is the specification that describes how, in terms of the phenomena of all the domains in the system, the requirement is fulfilled. For example, the requirement “given a temperature input in Fahrenheit, the system shall display that temperature in Celsius” is describing some input phenomena on one domain (probably a keyboard) and some output phenomena of another domain: the display; these are the requirement phenomena. The rest of the phenomena in the system exist to make the system produce its output requirement phenomena, given its input requirement phenomena.«

(Charles B. Haley, Arguing Security: A Framework for Analyzing Security Requirements)

Auf den Datenschutz übertragen finden wir unter einem Begriff, eben Datenschutz, eine bunte Mischung von Anforderungen und Spezifikation. Zu den Anforderungen gehören Ideen wie die der informationellen Selbstbestimmung und des Persönlichkeitsrechts und ihre Konkretisierungen. Alle spezifischen Regelungen hingegen stellen eine Spezifikation dar, eine Umsetzung der Anforderungen.

Dass beides in einem Gesetz vermischt ist, bedeutet nicht, dass die Spezifikation automatisch die Anfoderungen erfüllt. Ich bin der Ansicht, dass sie das im Fall des Datenschutzes heute nur noch teilweise tut. Daraus folgt nicht die Forderung nach einer Abschaffung des Datenschutzes, sondern die Forderung nach einer Anpassung der Spezifikation.

Deutlicher wird das, wenn wir die begriffliche Unterscheidung zwischen Anforderungen und Spezifikation in unsere Diskusionen abbilden. Ich bevorzuge deshalb die Bezeichnung Privatsphärenschutz für die Anforderungen. Ausdrücklich offen bleibt dabei, ob, unter welchen Bedingungen und in welchen Ausprägungen Datenschutz gemäß der aktuellen Spezifikation ein geeignetes und das einzige Mittel dazu ist. Vielleicht fällt uns ja noch was besseres ein.

Mein Verstärkerschaum

Die Filterblase gehört zu den Standards der Netzkritik. Dem Informationsfluss in sozialen Netzen wird der Begriff jedoch nicht gerecht.

Mir gegenüber im Büro sitzt ein ausgebildeter Philosoph und Volkswirt, der ein paar Jahre in der IT-Wirtschaft gearbeitet hat und jetzt an seiner Dissertation über Sicherheitsmodellierung schreibt. Ihn kann ich Sachen fragen, von denen ich vorher noch gar nicht ahnte, dass ich sie je wissen wollte. Auch ohne Fragen zu stellen bekomme ich von ihm ein unterschwelliges Bewusstsein anderer Denkkulturen und Begriffswelten, durch spontane Diskussionen, selbst geführte oder mitgehörte. Dies ist keine Ausnahme, sondern ein repräsentatives Beispiel aus meinem Alltag. Wo soziale Interaktion ins Spiel kommt, wird aus der Filterblase ein Verstärkerschaum für nur sehr grob eingegrenzte Informationen und eine gehörige Portion Rauschen. Da (auch da) war mein Gedankengang noch nicht fertig, deswegen hier ein eigener Text.

Den Begriff der Filterblase (Filter Bubble) prägte Eli Pariser:

»Your filter bubble is your own personal, unique universe of information that you live in online. What’s in your filter bubble depends on who you are, and it depends on what you do. But you don’t decide what gets in — and more importantly, you don’t see what gets edited out.«

Er bezog sich auf adaptive Algorithmen in Suchmaschinen und anderen Diensten, die Informationen auf unsere Wünsche und Bedürfnisse zuschneiden sollen. Über unerwünschte Nebenwirkungen solcher Technologien nachzudenken, ist gut und richtig. Pariser sagt selbst, dass es ihm nicht um die Abschaffung aller Filter geht, sondern um die Transparenz. Wir müssen dabei aber den Kontext beachten. Niemand von uns nimmt die Welt nur durch eine Suchmaschine wahr, wir haben auch noch ein soziales Umfeld. Soziale Netzen können deshalb aus der Filterblase ein nützliches und kontrolliertes Werkzeug machen.

Ich bin Informatiker und beschäftige mich mit IT-Sicherheit. Das sind bereits zwei weite Felder. Die Informatik umfasst eine Reihe von Teildisziplinen; mit Themen der IT-Sicherheit beschäftigen sich neben Informatikern auch Psychologen, Soziologen, Anthropologen, Ökonomen, Juristen, Politiker, Manager, Journalisten und, wie wir eingangs sahen, auch Philosophen. Daneben interessieren mich andere Themen: Sprache und Sprachen; Radverkehr; Jonglieren in Theorie und Praxis; Design; Fotografie; sowie allerlei Dinge, die mir gar nicht so bewusst sind. Außerdem lese ich heimlich Modeblogs, damit man mir den Informatiker auf der Straße nicht gleich ansieht.

Diese Interessen finden sich, über mehrere Plattformen sowie das richtige Leben verteilt, in meinen sozialen Netzen als Attribute meiner Mitmenschen wieder. Dort gibt es Menschen, deren Output mich interessiert; ihr Tun hängt in irgeneiner Weise mit meinen Interessen zusammen. Hinzu kommen alte Bekannte, die ihre Leben leben, sich weiterentwickeln und neue Themen für sich entdecken, wie auch ich das als alter Bekannter von anderen tue.

Diese Menschen besitzen ihrerseits jeweils einen Satz von Interessen, dessen Übereinstimmung mit meinen Interessen partiell bleibt. Das hat zur Folge, dass immer wieder Inhalte den Weg zu mir finden, die mit meinen unmittelbaren und mir bewussten Interessen wenig zu tun haben. Aufgrund der Besetzung meiner Circles, wie das bei Google+ heißt, bekomme ich in der Summe ein Signal aus Nachrichten zu Themen, die mich explizit interessieren, überlagert von Störungen, die vielleicht produktiv, vielleicht auch mal lästig sind. Indem ich meine Circles pflege, bestimme ich grob die Anteile verschiedener Themen am Signal. Das Störsignal dagegen kann ich nur dem Umfang nach steuern, den Inhalt kontrolliere ich nicht. Je perfekter ich Störungen zu vermeiden versuche, desto mehr Arbeit habe ich damit. Also nehme ich sie hin, solange mir das Nutzsignal gefällt. Das ist das Gegenteil von Eli Parisers Suchmaschinenszenario, wo ich einer nicht steuerbaren Suchmaschine ausgeliefert bin. Ich habe, mit den genannten Einschränkungen, die Kontrolle darüber, welche Schwerpunkte ich in meinem Eingabestrom setze. Ich liefere mich einer Gruppe von Menschen aus, die ich selbst auswähle. Diese Menschen zeigen und erzählen mir, was ihnen wichtig ist.

In sozialen Netzen lebe ich deshalb nicht in einer Filterblase, sondern in einem Verstärkerschaum. Aus dem globalen Palaver von derzeit ungefähr zwei Milliarden Internetbewohnern verstärken mir soziale Netze ein Nutzsignal, mit dem ich etwas anfangen kann, das aber keineswegs rauschfrei ist. Zu jedem Menschen gehört eine Sammlung unterschiedlich großer Awareness-Blasen zu verschiedenen Themen. Nicht feste Wände begrenzen diese Blasen, sondern durchlässige Membranen. Alle Blasen ändern fortwährend ihre Göße und Position.

Das ist kein Hexenwerk, sondern so funktioniert das richtige Leben, wo wir ebenfalls Ideen weitertragen und unsere Freundes-, Bekannten- und Kollegenkreise nicht filtern, sondern bestimmte Arten von Informationen verstärken. Das Netz bildet solche Beziehungen und Vorgänge nach und erweitert dabei meinen Horizont. Es befreit mich von räumlichen Beschränkungen und es erlaubt mir den effizienten Umgang mit einer größeren Zahl von Menschen und ihren Äußerungen.

Wollte ich aus sozialen Netzen eine echte, dichte Filterblase machen, müsste ich das explizit tun. Ich müsste die Träger unwillkommener Ansichten und die Überbringer unangenehmer Nachrichten öffentlich als Trolle klassifizieren und mich der Zustimmung meines sozialen Umfelds vergewissern, indem ich diese Aussätzigen mit großer Geste aus meinem Blickfeld und dem meiner Umgebung verbanne. Einige Blogger sind sehr eifrig darin, dies in ihren Kommentaren zu tun – aber auch das ist Selbstbestimmung und ihre Probleme sind nicht meine Probleme.

Die Gegenthese dazu ist nicht die Filterfreiheit, denn ganz ohne Filter geht es nicht. Wo 2 Milliarden Menschen durcheinander kommunizieren, höre ich ohne jeden Filter nur noch ambiente Geräusche. Es geht deshalb nicht darum, ob wir filtern, sondern wie. Keine Nachricht hat per se einen Anspruch darauf, meine Filter zu durchdringen. Wichtige Nachrichten aber haben bessere Chancen, von meinem Filter verstärkt zu werden, weil Nachrichten gerade dadurch wichtig werden, dass viele sie wichtig finden. Ich mache mir wenig Sorgen, dass ich Entscheidendes verpassen könnte. Jeder Shitstorm, jedes Mem gibt mir Recht.

Datenkrake Google (7/7): Privatsphärenschutz in der Datenwolke

[Inhalt – Teil 1 – Teil 2 – Teil 3 – Teil 4 – Teil 5 – Teil 6 (+Nachtrag) – Teil 7]

Wir haben uns in den Artikeln dieser Serie ein Modell gebildet, was Google mit Daten macht, welche Prinzipien dahinter stecken und wie daraus optimierte und partiell personalisierte Funktionen werden. Wir haben gesehen, dass naive Vorstellungen von Nutzerprofilen wahrscheinlich falsch sind. In Wirklichkeit betreibt Google automatisierte Verhaltensforschung im Industriemaßstab, bezogen auf spezifische Funktionen wie Eingabekorrektur, Übersetzung oder Werbeoptimierung. Als Ergebnis gewinnt Google populationsstatistische Aussagen, die individuell beziehungsweise nach impliziter Gruppenzugehörigkeit modifiziert werden können; eine klare Grenze zwischen diesen Aggregationsgraden gibt es nicht. Erfasst und gespeichert sind Googles Erkenntnisse in den Konfigurationen aufgabenspezifischer Klassifikatoren, die laufend dem globalen Verhalten der Nutzerpopulation angepasst werden. Die naiven Modelle aus Folge 2 passen nicht so recht dazu, auch wenn Google selbst manchmal anderes suggeriert:

Damit es keine Missverständnisse gibt: Google besteht nicht nur aus lernenden Maschinen, viele Funktionen und Dienste nutzen auch herkömmliche Verfahren. Welche Termine in meinem Google-Kalender stehen, wen ich in Google+ in welchen Circles habe und welche Nachrichten in meinem GMail-Account liegen, speichert und verarbeitet Google (auch) ganz normal im Klartext, wie es jeder SaaS-Anbieter in der Cloud tun würde. Darauf mag man alle etablierten Begriffe und Modelle des Datenschutzes anwenden, wenngleich sie sich vielleicht aus anderen Gründen als unpassend erweisen. Ich behandle hier die Angstfunktion Daten sammeln und auswerten. Daten einfach zu sammeln lohnt sich im Google-Maßstab nicht, weil man mit einer Datenhalde wenig anfangen kann. Nach meinem Modell nutzt Google umfangreiche Daten, um damit einen Satz an Betriebsparametern fortlaufend zu optimieren und dem Lauf der Welt anzupassen. Die Optimierung und Anpassung erfolgt interaktiv, Google lernt von seinen Nutzern, was richtig und was falsch ist, was ähnlich und was verschieden. Das ist etwas anderes als das elektronische Profil, das Thilo Weichert sich vorstellt und es hat Folgen, die er sich nicht vorstellt.

Was ist anders?

Ein Klassifikator häuft nicht einfach Daten an. Er besitzt eine Konfiguration und zwei Grundfunktionen, Lernen und Klassifizieren. In der Funktion Klassifizieren erhält er einen Datensatz als Eingabe und gibt eine Entscheidung oder Entscheidungsempfehlung aus. In der Funktion Lernen passt er seine Konfiguration an, um die Rate der Fehlentscheidungen zu reduzieren. Die Konfiguration des Klassifikators gibt nicht die einzelnen Eingabedaten wieder, sondern ein davon abgeleitetes Modell. Darin unterscheidet sich dieser Ansatz von der Karteikarten-IT herkömmlicher Datenbanken, die alle Eingaben wörtlich abspeichern und als Ausgabefunktion im wesentlichen das Herausfiltern der jeweils gesuchten Daten anbieten. Welche Daten ein Klassifikator nutzt und was er über uns weiß, sind zwei Paar Schuhe. Wir können einen Klassifikator nicht danach befragen, welche Eingabedaten er zu einer Person erhalten hat.

Das führt zu interessanten Folgerungen für den Privatsphärenschutz:

- Verhaltensbeobachtung und -auswertung bedeutet nicht zwingend eine Verletzung der Privatsphäre. Beispiele dafür sind die Korrekturfunktionen in der Google-Suche und in Google Translate, die aus dem Benutzerverhalten lernen. Google beobachtet bestimmte Aspekte des Nutzerverhaltens über eine Folge von Vorgängen hinweg, interessiert sich am Ende aber vor allem für statistische Aussagen.

- Ein Kontinuum an Personenbezug. Ein Klassifikator kann personenbezogene Entscheidungen treffen, er muss es aber nicht. Er wird Entscheidungen nach den Kriterien treffen, die in der Vergangenheit erfolgreich waren. Da die Konfiguration des Klassifikators variabel ist, kann sich der personenbezogene Entscheidungsanteil laufend ändern. Nützlich ist ein Klassifikator vor allem dort, wo es verallgemeinerbare Zusammenhänge in den Daten gibt – Verallgemeinerung ist das Gegenteil von persönlichen Profilen. Die vielen Einzeldaten braucht man , weil man die Verallgemeinerungsregeln vorher nicht kennt.

- Einzelne Merkmale – IP-Adresse, Cookies, Geburtsdatum und so weiter – sind wenig relevant. Klassifikatoren arbeiten in vieldimensionalen Merkmalsräumen und bei guter Konstruktion tragen alle Dimensionen zur Klassifikationsleistung bei. Lässt man eine Merkmalsdimension weg, bleiben (n-1) übrig, für ein ziemlich großes n. Die Klassifikationsleistung verringert sich dadurch nur wenig, zumal in den verwendeten Daten Korrelationen zwischen mehreren Dimensionen auftreten können. Das heißt auch: ein Klassifikator kann relativ robust gegen gelöschte Cookies sein.

- Der Grad der Personalisierung hängt auch vom Nutzerfeedback ab. Wie stark die Entscheidungen eines Klassifikators personalisiert sind, hängt davon ab, welches Feedback der Nutzer zu diesen Entscheidungen gibt. Wer viel Werbung anklickt, personalisiert seine Werbeeinblendungen damit, falls dieses Feedback mit Personen- oder Pseudonymbezug zum Lernen verwendet wird.

- Klassifikator-Modelle sind inhärent zweckgebunden. Ein Klassifikator wird für eine bestimmte Aufgabe entworfen und trainiert. Zwar kann man die dabei entstehende Konfiguration als Modell der Problemlösung untersuchen und dabei Interessantes herausfinden. Jedoch lässt sich ein Klassifikator nicht einfach für etwas anderes verwenden. Einen universellen Klassifikator, der »alles« kann, gibt es nicht; jedes Optimierungsverfahren benötigt Annahmen über das Problem. Man kann freilich einen Klassifikator mit Personen als Ausgabeklassen bauen, wenn man Feedback über die Richtigkeit der Zuordnung bekommt.

- Löschen geht nicht – aber Personenbezüge können verblassen. Sind Daten über einen Nutzer in die Konfiguration eines Klassifikators eingeflossen und dort mit anderen Daten verschmolzen, lässt sich dieser Vorgang nicht sinnvoll rückgängig machen. Liefert ein Nutzer keine neuen Daten nach, werden seine Einflüsse jedoch nach und nach von anderen überlagert. Ein fortwährend trainierter Klassifikator in einer veränderlichenUmgebung verliert im Laufe der Zeit seine Fähigkeit, auf diesen Nutzer personalisierte Entscheidungen zu treffen – er vergisst, ohne auf den Innenminister und dessen Ideenwettbewerb zu warten.

Solche Phänomene sind in unseren überlieferten Datenschutz-Konzepten nicht vorgesehen. Wir können auf verschiedene Arten damit umgehen. Wir können auf die Einhaltung formaler Vorschriften aus einer anderen Zeit pochen und Bürokratie als Selbstzweck vollziehen. Dann ist Google verboten, bis jeder Nutzer eine Generalvollmacht erteilt hat und ab und zu gibt es einen Shitstorm. Oder wir erinnern uns daran, dass Datenschutz als Mittel zum Zweck unserer Selbstbestimmung über unsere Privatsphäre dienen soll. Dann müssen wir bei diesem Ziel ansetzen und uns neu überlegen, wie die Technik es bedroht und wie vielleicht auch nicht.

Datenschutzreformen

Juristen diskutieren seit geraumer Zeit über Datenschutzreformen. Thomas Stadler berichtete zum Beispiel in seinem Blog über ein Thesenpapier zur Datenschutzreform (hier gibt’s einen Aufsatz dazu). In der Rechtsanwendung gibt es noch einmal ganz eigene Probleme. Aus Amerikanisch-Kanadischer Sicht beschäftigt sich Tara Whalen mit der Frage, wie man den Personenbezug sinnvoll definieren sollte und fasst im Artikel This Time, It’s Personal. Recent Discussions on Concepts of Personal Information (paywalled) den Stand der Debatte zusammen.

Als Informatiker kann ich dort nicht qualifiziert mitreden. Mir stellen sich andere, aber verwandte Fragen: Wie sieht wirksamer Privatsphärenschutz in heutigen und künftigen soziotechnischen Systemen aus? Von welchen Bedrohungsmodellen muss er ausgehen und wie kann er die Evolution der Technik zulassen und begleiten?

Cookies, IP-Adressen und die Datenübermittlung in andere Länder nützen uns als Diskussionsrahmen wenig. Die Radikallösung, Teile des Netzes ungenutzt zu lassen, ist wegen seines großen Nutzens keine realistische Option. Interessanter ist, wer uns anhand welcher Daten wehtun kann, wie wahrscheinlich das ist, und welche wirksamen Maßnahmen es dagegen gibt.

Die Abstraktion des personenbezogenen Datums und der Entscheidung des Betroffenen, wer dieses Datum haben darf, stammt aus einer anderen Ära der Informationstechnik. Unabhängig davon, in welchem Maße Techniken wie die von Google eingesetzten unsere Privatsphäre bedrohen oder nicht, können wir mit der Freigabe einzelner Datensätze und Datenfelder keinen sinnvollen Einfluss auf eventuelle Risiken nehmen. Vielleicht müssen wir uns gänzlich von der Idee lösen, dass es auf Daten ankäme, und uns damit beschäftigen, was daraus gemacht wird.

Die individuellen und gesellschaftlichen Privatsphären-Interessen müssen wir außerdem abwägen gegen das berechtigte Interesse einer Firma wie Google, technische Details für sich zu behalten. Bessere Klassifikatoren zu bauen als der Rest der Welt gehört zu Googles Kerngeschäft. Andererseits sollte die Technik so transparent sein, dass sie informierte Entscheidungen unterstützt, wobei es auf die Entscheidungen ank0mmt und nicht auf deren formalisierte Niederlegung im Vertragsstil. Mit diesem Spannungsfeld sowie mit realistischen Bedrohungsmodellen muss sich der organisierte Datenschutz beschäftigen, wenn er in Zukunft relevant bleiben möchte. Laut über Daten-Schmu zu schimpfen und dann weiter alte Modelle auf neue Technik anzuwenden, bringt uns keinen Schritt weiter.

Schlusswort

Google ist im wahrsten Sinn des Wortes ein Elektronengehirn, wie es die Science Fiction einst beschrieb. Wer um jeden Preis Angst haben möchte, stellt sich unter Google am besten so etwas wie HAL 9000 vor, hochskaliert auf einen Planeten anstelle eines Raumschiffs. Google verhielte sich ähnlich, zöge man ihm nach und nach die Speichermodule raus – Google würde nach und nach verblöden.

Unter dieser Prämisse lautet die Grundsatzfrage: Welche Denkverbote müssen wir so einem Computer auferlegen und welche nicht? Wie formulieren wir solche Denkverbote, wenn wir den größtmöglichen Nutzen behalten wollen? Oder brauchen wir in Wirklichkeit gar keine Denkverbote für Elektronengehirne, sondern angemessene Denkweisen und Begriffe für uns selbst als Individuen und als Gesellschaft? Fürs erste tut es auch eine kleinere Frage: Wie machen wir eine Datenverarbeitung transparent für Nutzer, die komplizierter ist als die gute alte Datenbank? Ein Stück Verständnis hat Google mit seiner aufgeräumten Datenschutzerklärung schon mal effektiv vermittelt, nämlich dass seine einzelnen Dienste nur Sichten auf ein System sind. Das haben jetzt alle verstanden.

Zum Download. Eine Ergänzung zu Teil 6

[Inhalt – Teil 1 – Teil 2 – Teil 3 – Teil 4 – Teil 5 – Teil 6 (+Nachtrag) – Teil 7]

Eben bin ich noch über diese schöne Illustration zu Teil 6 von Datenkrake Google gestolpert:

Die obere Anzeige betitelt ihren Link einfach mit Zum Download. Genau danach habe ich gesucht, nach einem Download, diese Anzeige wird an dieser Stelle sicher hervorragend funktionieren, gerade weil nicht aus ihr hervorgeht, was sich eigentlich dahinter verbirgt. Für so eine Optimierung braucht man gewissenloses, nüchtern-rationales Personal, zum Beispiel einen Computer, dessen einzige Mission in der Klickratenoptimierung besteht.

Über mich weiß Google offensichtlich, dass ich Deutsch spreche. Das erzählt mein Browser allerdings jeder Website und ich mache auch sonst kein Geheimnis daraus.

Datenkrake Google (6/7): Und jetzt Werbung

[Inhalt – Teil 1 – Teil 2 – Teil 3 – Teil 4 – Teil 5 – Teil 6 (+Nachtrag) – Teil 7]

Über die bisherigen Folgen dieser Serie haben wir ein Modell von Google als lernender Maschine etabliert. Vermutlich ist dieses Modell nicht die reine Lehre hinter Googles Werbediensten, da Google vor einigen Jahren Doubleclick und damit fremde Technologie gekauft hat. Gleichwohl lohnt es sich, anhand unseres Modells über optimierte (volkstümlich: personalisierte) Werbung nachzudenken. Weit hergeholt wird es nicht sein; dass Google Techniken wie die skizzierten zur Optimierung von Suchergebnissen und Empfehlungen einsetzt, können wir mit unserem Vorwissen aus den Changelogs herauslesen. Technisch macht es keinen großen Unterschied, ob wir das beste Suchergebnis, die beste Empfehlung zu irgend etwas oder die beste Werbung für einen Anzeigekontext suchen. Aber der Reihe nach.

Personalisierung ist Optimierung

Werbung ist ein Optimierungsproblem. Ziel des Werbers ist, genau dort aufzutreten, wo seine Werbung wirkt, und auch nur dafür zu bezahlen. Klassisch, ob offline oder online, tut man dies, indem man Zielgruppen klassifiziert und seine Werbung bzw. sein Produkt einerseits und die verfügbaren Medien andererseits in dieses Modell abbildet. Erreicht ein Medium möglichst genau die anzusprechende Zielgruppe, schaltet man seine Werbung dort. So kommt die Telefonsexwerbung ins Nachtprogramm von Privatsendern, die Werbung für Pay-TV-Sportsender in die Sportzeitschrift und das ThinkGeek-Banner auf Slashdot. Erscheinen die Streuverluste zu hoch, versucht man die Zielgruppendefinition zu verfeinern. Dieses Vorgehen entspricht dem regelgestützten Ansatz der klassischen KI.

Gemäß der Google-Philosphie würde man hingegen aus allen verfügbaren Daten über die Werbung, den Anzeigekontext und, soweit verfügbar, den Nutzer vor dem Bildschirm alle denkbaren Merkmale extrahieren. In diesem Datenraum würde man einen lernenden Klassifikator auf die Frage ansetzen, welche Cluster die Klickrate als Hilfsmetrik oder besser noch die werbebezogenen Umsätze des Kunden maximieren. Man würde also das tun, was ich in Folge 4 beschrieben habe, nur mit einem Pool von Anzeigen anstelle von Tanksäulen und Abrufereignissen anstelle von Autos mit Fahrern. Seinen Kunden würde man ein Interface zur Verfügung stellen, mit dem sie neue Zapfsäulen aufstellen und bezahlen können. Selbst müsste man nur noch seine Einnahmen kassieren und verbuchen und alte Zapfsäulen wegräumen. Alles andere liefe komplett automatisch ab.

Die tatsächlichen Regeln, nach denen die Einblendung erfolgt, wären wieder Sache des Klassifikators und von Fall zu Fall verschieden. Zur Entscheidung könnte der Inhalt der Anzeige ebenso beitragen wie der Kontext der Einblendung oder Informationen über den Nutzer. Vielleicht sind Anzeigen mit bestimmten Merkmalen besonders erfolgreich bei europäischen Nutzern des Browsers Firefox ohne Flash Player zwischen 19:23 Uhr und 20:42 Uhr an Samstagen, sofern diese Nutzer nicht in ihren Google-Account eingeloggt sind, die Werbeeinblendung auf einer bestimmten Website erfolgt und der Nutzer diese Anzeige zuvor höchstens zweimal gesehen hat. Eine andere Anzeige könnte bei Nutzern aus einem bestimmten Universitätsnetz gut ankommen, unabhängig vom verwendeten Browser und der Uhrzeit, eine weitere in einem bestimmten Anzeiogekontext gut funktionieren. Dem lernenden Klassifikator ist egal, ob solche Regeln für uns einen Sinn ergeben. Er optimiert stur auf die Daten, die man ihm zeigt.

Textanzeigen enthalten dabei genau jene Art von Merkmalen, mit denen Google ohnehin bereits gut umgehen kann. Für Werbebanner wird man etwas länger nachdenken müssen, welche Merkmale nützlich sind. Wer weiß, vielleicht hat ja die Blinkfrequenz einen Einfluss auf die Klickrate, oder Metadaten aus der klassichen Zielgruppendefinition erweisen sich als nützlich. Grundsätzlich funktioniert das Prinzip auch dann, wenn wir die verschiedenen Anzeigen lediglich unterscheiden können und sonst keine Einzelheiten kennen. Ein Klassifikator hätte dann kein Ähnlichkeitsmaß für Anzeigen zur Verfügung, könnte aber immer noch lernen, unter welchen Begleitumständen Anzeige Nummer 703744 am besten funktioniert.

Was führt zum Klick?

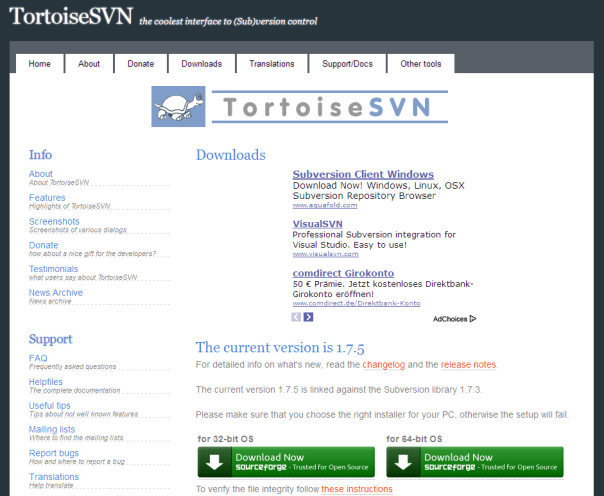

Alltagsbeobachtungen sind mit diesem Erklärungsmodell kompatibel. Nehmen wir zum Beispiel tortoisesvn.net. TortoiseSVN ist ein SVN-Client für den Windows-Explorer; die Website besuchen vermutlich viele Leute, die diesen Client erstmals oder als Update herunterladen möchten. Google blendet dazu Werbung für andere SVN-Clients ein. Was’n Quatsch?! Gar kein Quatsch, sondern folgerichtig.

Wer sich die Seite durch seine Usability-Brille anschaut, wird schnell bemerken, dass ihr Design einige Schwächen hat. Diese Schwächen führen dazu, dass der Nutzer von der Downloadfunktion ab- und auf die Werbung hingelenkt wird. Die echten Download-Buttons sind die grünen Kästen unten. Die wirken in ihrem Format und in ihrer knalligen, vom Rest der Seite abweichenden Farbe optisch wie ein typisches Werbebanner. Das Web hat uns über Jahre darauf trainiert, typische Werbebanner mental auszublenden und zu ignorieren. Hinzu kommt, dass über den Google-AdSense-Anzeigen der Titel Downloads steht und dann außer den Anzeigen kein Inhalt folgt, und die dass Anzeigen farblich der Seitengestaltung angepasst sind. Ist unter den Anzeigen nun noch eine, die einen SVN-Client anbietet, liegt ein versehentlicher Klick auf die Anzeige nahe – alles wirkt auf den Nutzer so, als könne er damit sein Ziel erreichen.

Nach einigen zufälligen Einblendungen, die zu Klicks führen, lernt das auch ein Klassifikator, der Klickraten optimiert. Stehen ihm die nötigen Parameter zur Verfügung, wird er fortan in diesem Kontext bevorzugt Werbung für SVN-Clients anzeigen, falls er welche im Pool hat. Über den einzelnen Nutzer muss er dazu nichts wissen, er lernt nur etwas über eine spezifische Auswirkung allgemeiner Psychologie in einem spezifischen Kontext. Auf ähnliche Weise dürfte SEO-Werbung in einen SEO-Artikel gelangen:

Persönliche Informationen über den Betrachter sind für diese Einblendungen nicht erforderlich – sie können jedoch jederzeit in die Entscheidung einfließen, wenn sie verfügbar und relevant sind. Ob und wo das der Fall ist, erfährt Google nach unserem Modell aber nicht aus den Daten, die wir uns als unser Nutzerprofil vorstellen, sondern aus unseren Werbeklicks. Wer nie Werbung anklickt, schafft keine Möglichkeit zur Personalisierung; Google muss sich dann auf eine optimierte und automatisierte Anwendung der herkömmlichen Targeting-Praktiken beschränken. Zwar werden die Eingabedaten in den Klassifikator genauer, je mehr Google vorher über mich weiß. Google kann aber nicht herausfinden, ob mich diese Details im Hinblick auf das Klassifikationsziel von anderen Teilen der Population unterscheiden. Mit jedem Nichtklick übermittle ich dem Klassifikator nur die Information: »Sorry, das war nicht die richtige Lösung.« Ich bekomme meine Werbung dann gemäß der Populationsstatistik so wie diejenigen die in denselben Clustern landen.

So füttert man Datenkraken

Klicke ich dagegen regelmäßig Werbung an, liefere ich nach und nach ein Modell dafür, wie der Werbeerfolg von meiner Person abhängt. Auch wenn es anders wirkt, erfährt Google dabei immer noch wenig über mich. Google kann dann vorhersagen, wie meine Anwesenheit im Verglich zu anderen Nutzern oder zur Populationsstatistik das Relevanzmodell für Werbeeinblendungen in einem bestimmten Kontext modifiziert. Wenn Google sich anstrengt, gibt der Klassifikator vielleicht auch noch eine – für Googles Zwecke bedeutungslose und in der Begriffswelt des Klassifikators ausgedrückte – Erklärung seiner Entscheidung her. Um systematisch solche Erklärungen über mich zu erheben, müsste Google aber schon wieder zusätzliche Daten neben der Konfiguration des Klassifikators erfassen und speichern.

Zieloptimierte Werbung a la Google funktioniert also wahrscheinlich nicht so, wie es die naiven Modelle aus Folge 2 suggerieren. Wenn mein Verständnis richtig ist, gilt es gleichermaßen auch für andere personalisierte Funktionen und nicht nur für die Werbung. Im letzten Teil der Serie betrachten wir die Auswirkungen solcher Technologien auf den Datenschutz.

Datenkrake Google (5/7): Daten besiegen die Logik

[Inhalt – Teil 1 – Teil 2 – Teil 3 – Teil 4 – Teil 5 – Teil 6 (+Nachtrag) – Teil 7]

Die vorige Folge dieser Artikelserie behandelte die Frage, wie Maschinen lernen können. Diese Technik ist für Google ein zentrales und dienstübergreifendes Paradigma (freies PDF). Im Vorbeigehen bekommen wir damit eine Erklärung, warum die Metapher von Google+ als Facebook-Konkurrenz nicht funktioniert (vgl. Teil 1). Facebook (der Dienst) ist für Facebook (die Firma) der Kern des Geschäftsmodells. Für Google dagegen ist maschinelles Lernen aus allen Daten dieser Welt der Kern des Geschäftsmodells – und Google+ vor allem eine weitere Quelle interessanter Daten. Wer interagiert wie mit wem? Welche Inhalte verbreiten sich in welchen Kreisen? Wie reagieren Nutzer auf personalisierte Suchergebnisse? Welche Transformationen durchläuft ein Gerücht? Welche Merkmale unterscheiden ein Mem von einem Shitstorm? Alleine die Liste der Fragen, zu denen man mit Googles Philosophie der Datenverarbeitung in Google+ nach Antworten suchen könnte, scheint endlos. Mit Facebook hat Google+ deshalb nur einige oberflächliche Funktionen gemeinsam, es dient aber – mutmaßlich – einem ganz anderen Zweck.

Künstliche Intelligenz, diesmal richtig

Doch funktioniert das überhaupt? Ist die KI nicht tot? Das ist sie, aber Google macht gerade keine klassische KI. Anfangs versuchte man in der KI, alle wesentlichen Aspekte eines Problems in nachvollziehbare Regeln zu fassen. Man versuchte also, Gehirne sich selbst beschreiben zu lassen. Das war ungefähr so schlau wie der Versuch, eine Turing-Maschine Aussagen über Turing-Maschinen machen zu lassen, aber irgendwo musste man ja anfangen und das Internet als reichhaltige Datenquelle gab es auch noch nicht.

Letztlich geht es auch im Google-Ansatz um Regeln, aber formuliert werden sie nun unter Verwendung aller verfügbaren Daten und ohne die Notwendigkeit, dass ein Mensch diese Regeln nachvollziehen kann. Dass dabei bessere Regeln herauskommen können als aus menschlichen Gehirnen, gerade wenn das Problem kompliziert ist, zeigt ein Beispiel aus der IT-Sicherheit.

Bozorgi et al. beschäftigen sich in ihrem Paper Beyond Heuristics: Learning to Classify Vulnerabilities and Predict Exploits (freies PDF) mit der Vorhersage der Exploit-Wahrscheinlichkeit aus Verweundbarkeitsmeldungen. Gefundene Verwundbarkeiten in Software dokumentiert die Security-Community in Datenbanken, zum Beispiel der CVE oder der OSVDB. Ein Bewertungsschema für Verwundbarkeiten ist der CVSS-Score, ein Wert zwischen 0 und 10, der die Schwere des Problems angibt. 10 ist ganz schlimm, 0 völlig harmlos. Dieser Score wird auf eine nachvollziehbare und sinnvoll erscheinende Weise aus einer Reihe von Parametern gebildet. Für eine gegebene Verwundbarkeit in einer Software oder in einem System kann man sich den Score aus einigen Einschätzungen zusammenklicken und das Ergebnis stimmt meistens mit der Intuition des Fachmanns überein.

Computer schlägt Experten

Man sollte meinen, dass dieser Wert einen Anhaltspunkt liefert, ob ein Security-Bug nach seiner Entdeckung auch für Angriffe ausgenutzt wird – die mit dem Score 10 oft, die mit dem Score 0 nie. Bozorgi et al. zeigen jedoch, dass der CVSS-Score darüber wenig voraussagt, und stellen dem ihm einen angelernte Klassifikatoren gegenüber. Diese Klassifikatoren benutzt die gesamte Verwundbarkeitsdokumentation und liefert weit bessere Vorhersagen darüber, ob und wie schnell eine Verwundbarkeit ausgenutzt wird oder nicht.

Der verwendete Merkmalsraum hat 93.578 Dimensionen, die meisten abgeleitet aus Textfeldern wie den Namen der betroffenen Produkte oder den Freitextbeschreibungen des jeweiligen Sicherheitsproblems. Viele Dimensionen sind binär und geben einfach an, ob bestimmte Worte, zum Beispiel Buffer, in bestimmten Teilen eines Berichts vorkommen. Klassifikator lernt Cluster für ausgenutzte sowie für nicht ausgenutzte Verwundbarkeiten. Nebenbei liefert dieser Klassifikator noch einen Score, der sich daraus ergibt, wie weit eine Verwundbarkeitsmeldung nach der Merkmalsextraktion von der Clustergrenze entfernt liegt. Was tief im Cluster liegt, ist den anderen Punkten dort sehr ähnlich; was nahe der Grenze liegt, könnte nach kleinen Änderungen auch auf der anderen Seite, im anderen Cluster landen.

Das wirkt alles ein wenig wie Zauberei. Im Grunde genommen tut Google aber nichts anderes als unser Gehirn, nur ohne den Filter unserer Sinnesorgane, ohne Abgleich mit Lehrbuchwissen und mit viel mehr Daten und Aspekten dieser Daten als uns normalerweise bewusst werden. Google lernt Sprachen – oder Expertenintuition – wie wir, nur schneller und ohne den Umweg über Übungen und explizite Regeln direkt aus Beispielen und Feedback. Und wir sind die Lehrer.

Im nächsten Artikel werden wir uns damit beschäftigen, wie man mit lernenden Maschinen Werbeeinblendungen optimiert.

Datenkrake Google (4/7): Lernende Maschinen

[Inhalt – Teil 1 – Teil 2 – Teil 3 – Teil 4 – Teil 5 – Teil 6 (+Nachtrag) – Teil 7]

In der dritten Folge der Artikelserie haben wir betrachtet, dass Google aus Crowdsourcing und Statistik nützliche Funktionen und Dienste baut und dabei aus dem Netz und von seinen Nutzern lernt. Wie funktioniert dieses Lernen?

Eine globale Tankstelle

Stell Dir vor, wir wären die Tankstelle der Welt. Wir verkaufen jede Sorte Treibstoff, die jemals irgendwo entwickelt, benannt und angeboten wurde, jeweils an einer eigenen Zapfsäule. Bei uns tanken deutsche Autofahrer Diesel, Super und Super Plus, Spanier 95 sin plomo und gasóleo, Japaner Hai-oku und Keiyu, Ossis in alten Trabis ihr Zweitaktgemisch VK 88 1:33 und afghanische Taliban brennbare Flüssigkeit aus Fässern und Flaschen.

Unsere Tankstelle ist riesig und unübersichtlich. Wie schicken wir jeden Fahrer mit seinem jeweiligen Fahrzeug an die richtige Säule? Wir könnten unsere Kunden nach ihren Wünschen fragen, aber dazu müssten wir all ihre Sprachen sprechen. Manche Kunden wüssten auch gar nicht, was sie tanken wollen, weil sie gerade in einem geliehenen Fahrzeug sitzen oder weil sie vergesslich sind oder weil ihre robuste russische Technik alles schluckt, was flüssig ist und brennt.

Unsere Kunden hätten zudem unterschiedliche Präferenzen, die teils mit ihren Fahrzeugen zusammenhängen, teils aber auch nicht. Während Mutti ihren Kleinwagen immer genau so betanken möchte, wie es ihr der nette Mann in der Werkstatt schon dreimal aus gegebenem Anlass erklärt hat, ist das Verhalten von Top-Verkäufer Johannes E. komplizierter. Gewohnheitsmäßig kippt er Super++ in seinen Audi, geht eh‘ auf Spesenrechnung und man gönnt sich ja sonst nichts. Ist er aber spät dran und ein Kunde wartet, nimmt er die erstbeste freie Säule, an der er sein Auto nicht kaputtmacht. Dann ist 95 sin plomo eine Alternative zur Schlange an der Super++-Säule, das kennt er aus seinem Urlaub auf Mallorca. Wenn Du mit Johannes E. redest, wirst Du davon allerdings nichts erfahren, weil ihm das selbst nicht so bewusst ist. Seine Bedürfnisse zeigen sich erst, wenn Du sein Verhalten beobachtest. Seine Verhaltensmuster können sich übrigens jederzeit ändern, zum Beispiel weil Johannes E. die Firma und damit den Firmenwagen gewechselt hat. Plötzlich sitzt Johannes E. in einem Mercedes und ein anderer in seinem Audi.

Eine Datenbank hilft uns nicht

Eine klassische Datenbank hilft uns in dieser Situation wenig. Führen wir sie über Fahrzeuge oder Fahrezugtypen, verlieren wir die Fahrerpräferenzen; führen wir sie über Fahrer, bekommen wir deren Wechsel vom Diesel zum Erdgas nicht mit. Bilden wir Paare von Auto und Fahrer, haben wir lauter Spezialfälle in der Datenbank und scheitern jedesmal, wenn eine unbekannte Paarung vorfährt, etwa weil Johannes E. eine Panne hatte und heute einen Mietwagen betankt. Was wir stattdessen haben wollen, ist ein Klassifikator, der fast immer die richtige Entscheidung trifft und dabei vorhandene Informationen generalisiert. Außerdem möchten wir, dass sich unser Klassifikator anpasst, wenn sich die Welt verändert. Wir möchten ihm nicht jede Woche die neuesten Gerüchte aus der Auto BILD und deren Auswirkungen auf seine Tätigkeit einprogrammieren, das soll er schön selbst lernen.

Merkmalsextraktion

Solch einen Klassifikator können wir bauen, und wir können ihn lernfähig machen. Dazu überlegen wir uns zunächst, welche beobachtbaren Merkmale ein Auto nebst Fahrer hat: Farbe, Kennzeichen, Abmessungen, Motor- und Fahrgeräusche, Felgen- und Reifentyp, Anhängerkupplung, Dachgepäckträger, Sauberkeit, Anzahl der Türen, Spoiler, Spracheinstellung des Navigationssystems, eingestellter Radiosender; beim Fahrer Hautfarbe, Körpergröße, Haarschnitt, Gesichtsbehaarung, Kleidung, Gesichtsausdruck und so weiter. Wir sammeln also erst mal alle Merkmale ein, die wir messen können. Welche dieser Daten wir am Ende wirklich brauchen, wissen wir noch nicht genau, voraussichtlich von allen ein bisschen.

Jedes messbare Merkmal liefert uns eine Dimension in einem vieldimensionalen Raum. Fährt ein Auto an unserer Tankstelle vor, können wir es in allen Dimensionen messen und danach als Punkt in diesem Raum darstellen. Kleine Abweichungen, zum Beispiel durch den Wechsel von Winter- zu Sommereifen, führen zu kleinen Verschiebungen im Raum. Große Unterschiede, etwa zwischen Muttis Kleinwagen und Bennos Umzugslaster mit ihren jeweiligen Fahrern, führen zu großen Abständen.

Unser Klassifikator soll uns zu jeder Eingabe – einem Punkt im Raum, der unsere Messwerte zu einem Fahrzeug repräsentiert – eine oder mehrere wahrscheinlich passende Zapfsäulen ausgeben.

Feedback

Wenn unsere Kunden mitdenken und ohne Einweisung oder nach einer falschen Empfehlung selbständig eine für sie richtige Zapfsäule aufsuchen, können wir ihr Verhalten beobachten und daraus lernen. Jedesmal wenn jemand bei uns tankt, bekommen wir ein Datensample, einen Punkt im Raum und die für diesen Punkt richtige Entscheidung. Diese Samples sammeln wir sortiert nach richtigen Entscheidungen. Diese Sammlung könnten wir uns noch als Datenbank vorstellen, in der für jede Zapfsäule sämtliche Merkmale der dort beim Tanken gesehenen Auto-Fahrer-Paare hinterlegt sind. Das sind aber nur Rohdaten und wir werden gleich sehen, dass wir sie gar nicht auf Vorrat in einer Datenbank speichern müssen.

Automatische Verallgemeinerung

Unser Klassifikator soll diese Rohdaten generalisieren können, das heißt auch für solche Datenpunkte gute Entscheidungen treffen, für die bisher keine Beobachtungen vorliegen. Repräsentiert unser Datenraum alle oder die meisten für die Klassifikation relevanten Merkmale, so bilden die Rohdaten zu jeder möglichen Entscheidung einen Cluster: sie liegen näher beieinander als sie zu den Datenpunkten anderer Cluster liegen. In den Randbereichen kann es zu Überschneidungen kommen. Das liegt entweder an verrauschten Daten aufgrund von Messfehlern, oder an fehlenden Merkmalen. Beispielsweise könnten uns einige Parameter fehlen, die das Verhalten unseres Tankchaoten Johannes E. erklären würden, weil wir seinen Terminkalender nicht kennen.

Die maßgebliche Nachbarschaft zwichen den Datenpunkten eines Clusters besteht dabei oft nur in ausgewählten Merkmalsdimensionen, da nicht alle Merkmale gleichermaßen relevant sind. Welche Dimensionen das sind, kann sich von Cluster zu Cluster unterscheiden. Wir könnten an unserer Tankstelle zum Beispiel beobachten, dass rote deutsche Sportwagen fast immer Super tanken, während Lkw sowie silbergraue und schwarze Mittelklassewagen Diesel bevorzugen. Dieser Cluster ließe sich mit den Merkmalen Farbe und Größe recht genau beschreiben. Gleichzeitig könnten wir beobachten, dass Japaner unabhängig von Autotyp und Farbe stets die Säule Hai-oku bevorzugen, weil es ihnen als unhöflich gilt, öffentlich billigen Diesel zu tanken. Daraus ergibt sich wiederum für die anderen Cluster, dass dort das Merkmal Nationalität eine Rolle spielt, und sei es nur die, Japaner aus dem Cluster auszuschließen.

Repräsentanten für Cluster

Damit unser Klassifikator gut funktioniert, benötigt er Beschreibungen der einzelnen Cluster, ihrer Clustergrenzen und ggf. der Überschneidungen mehrerer Cluster. Um einen Datenpunkt zu klassifizieren, also eine Entscheidung zu treffen, müssen wir ihn dem passendsten Cluster zuordnen. Erweist sich eine Klassifikation als falsch, so wollen wir außerdem die betroffenen Clusterbeschreibungen anpassen, ohne uns jedoch von einzelnen Ausreißern unsere Statistik kaputtmachen zu lassen. Anstelle der Rohdaten im Datenbankformat verwendet man dafür Repräsentanten: für jeden Cluster bestimmt man einen Satz von Punkten, der diesen Cluster gut repräsentiert. Diese Repräsentanten liegen irgendwo zwischen den Rohdatenpunkten; ihre Anzahl ist in der Regel geringer.

Für das Beispiel von eben bekämen wir als Repräsentanten des Clusters zur Zapfsäule Hai-Oku gemittelte Erkennungsmerkmale japanischer Fahrer, für Super die gemittelten Merkmale von Sportwagen mit Fahrern, in deren Land Sportwagen Super tanken, und für Diesel gemittelte Merkmale von Lastern sowie von langweilig kolorierten Mittelklassewagen. Die Cluster können komplizierte Formen haben und müssen nicht zusammenhängen, deswegen mehrere Repräsentanten.

Um einen neuen Datenpunkt zu klassifizieren, suchen wir uns den oder die n nächstgelegenen Repräsentanten zu diesem Punkt und bestimmt daraus die Wahrscheinlichkeit der Clusterzugehörigkeit. Wir schicken das Fahrzeug an die Zapfsäule, deren Cluster die höchste Wahrscheinlichkeit hat. Klasse (d.h. Zapfsäule) und Wahrscheinlichkeit die Ausgaben des Klassifikators. Erweist sich die Entscheidung als falsch, analyisieren wir den Fehler und berechnen Korrekturen für die betroffenen Repräsentanten. Diese Korrekturen halten wir klein, Repräsentanten werden nur ein Stückchen in die richtige Richtung verschoben. Das macht unseren Klassifikator robust gegen einzelne statistische Ausreißer. Erst wenn systematische Fehler auftreten, akkumulieren sich viele gleichartige Korrekturen zu einer nennenswerten Verschiebung der Repräsentanten und Clustergrenzen. Beginnen können wir mit zufällig verteilten Repräsentanten; unser Klassifikator wird dann anfangs viele Fehler machen und schnell lernen.

Die Nutzerdaten werfen wir weg

Die ursprünglich erfassten Rohdaten, die gemessenen Merkmalswerte, können wir nach Verwendung wegwerfen. Dass Mutti beim Betanken ihres Kleinwagens immer eine Alditüte mit Einkäufen auf dem Beifahrersitz liegen hat, geht vielleicht als Merkmal in die Klassifikation ein – steht am Ende aber in keiner Datenbank. Wir brauchen diese Information nicht, unseren Klassifikator interessiert nur, ob der das Merkmal Alditüte berücksichten muss und falls ja, was es über die Clusterzugehörigkeit aussagt.

Wer genauer wissen möchte, wie statistische Inferenz und maschinelles Lernen funktioniert, und sich von Formeln nicht abschrecken lässt, findet im Buch Information Theory, Inference, and Learning Algorithms von David MacKay eine hervorragende und umfangreiche Einführung; das komplette Buch mit seinen 600 Seiten gibt es online als PDF-Datei. [Bevor Ihr jetzt anfangt zu drucken: die Amazon-Lieferung dauert auch nicht viel länger.]

In der nächsten Folge schauen wir uns die Leistungsfähigkeit und einige Implikationen dieses Ansatzes an.

Datenkrake Google (3/7): Statistisches Crowdsourcing

[Inhalt – Teil 1 – Teil 2 – Teil 3 – Teil 4 – Teil 5 – Teil 6 (+Nachtrag) – Teil 7]

Im vorigen Teil dieser Serie haben wir uns einige mentale Modelle angeschaut, die genau wie viele unserer Datenschutzkonzepte von der Informationstechnik des vorigen Jahrhunderts ausgehen. Jetzt nähern wir uns der Realität von heute, zunächst anhand einiger Dienste und Funktionen, die in Sachen Privatsphäre weniger kritisch sind.

Strategische Position

Google sitzt auf der Content-Schicht in der Mitte des Netzes. Alle online veröffentlichten Informationen kommen dort vorbei, und das inzwischen sehr schnell. Obendrein bietet Google mit der Suche einen Dienst an, den fast jeder Internet-Nutzer verwendet. Und die Google-Suche muss mit verrauschten Informationen umgehen können, um aus der Datenhalde Internet jeweils die relevanten Informationen herauszufiltern. Google setzt dafür auf Statistik, auf maschinelles Lernen und auf Crowdsourcing. Das illustrieren Funktionen der Suche sowie der Dienst Google Translate.

Wie baut man eine Rechtschreibkorrektur oder eine Suchbegriff-Autocompletion, wenn man in Googles Position ist? Wäre man Microsoft, würde man Wörterbücher und Grammatik-Engines in die Schachtel packen, in der man sein Office-Paket verkauft. Als Microsoft muss man alles vordenken, was der Nutzer jemals tun wird. Die einzigen Rückkanäle sind die Support-Hotline, gelegentliche Crash-Reports sowie der Markt. Ist man dagegen Google, so interagiert man bei jedem Tastendruck mit seinem Nutzer.

Homöopathisches Crowdsourcing

Darauf lassen sich Crowdsourcing-Modelle stützen. Crowdsourcing bedeutet in etwa andere arbeiten lassen. Das ist gar nicht so einfach wie es klingt. Verlangt man zu viel für zu wenig Gegenleistung, fühlen sich die anderen ausgenutzt und spielen nicht mit. Ein früher Versuch in dieser Richtung war Googles Image Labeler. Er verpackte das Finden von Schlagworten zu Bildern als Spiel – das schnell langweilig wurde. Am besten funktioniert andere arbeiten lassen, wenn die anderen damit gar keine Arbeit haben oder die Arbeit sowieso machen.

Eingabekorrekturen sind ein Beispiel. Wer sich vertippt und seinen Fehler bemerkt, der wird ihn korrigieren. Sind wir nun Google und haben wir einen interaktiven Kanal zu jedem einzelnen Internet-Nutzer, so bekommen wir täglich Millionen, vielleicht sogar Milliarden von Tippfehlern samt den zugehörigen Korrekturen frei Haus geliefert. Mit anderen Worten, Google erhält eine umfangreiche Tippfehler- und Korrekturstatistik über einen beachtlichen Teil der Weltbevölkerung. Der einzelne Fehler, die einzelne Korrektur oder auch das Profil eines einzelnen Nutzers sind dabei belanglos, während die Aggregation dieser Daten fast alles enthält, was man über Tippfehler und und ihre Berichtigungen wissen kann.

Wenn man Google ist, zapft man diese Datenquelle an und baut einen Mechanismus, der von den Nutzern lernt, wie Tippfehler zu korrigieren sind. [Das Teufelchen auf meiner linken Schulter unterbricht mich gerade und schlägt vor, einen Google-Korrektur-Flashmob zu organisieren, der Google einen falschen Korrekturvorschlag für Hommingberger Gepardenforelle antrainiert. Das Engelchen auf der rechten weint leise in einen Facepalm hinein.] Funktioniert so ein Mechanismus einmal, müssen wir uns um keine Rechtschreibreform mehr kümmern. Das übernehmen alles die Nutzer, indem sie sich ganz natürlich verhalten. Das ist etwas vereinfacht, weil Google außerdem auch noch das ganze Web kennt und auch daraus eine Menge über alle möglichen Sprachen lernen kann (freies PDF).

Welche Vervollständigungen für teilweise eingetippte Suchbegriffe in Frage kommen, können wir an Googles Stelle auf ähnliche Weise ermitteln. Wir beginnen mit einer Statistik über die eingegebenen Suchbegriffe und die Texte im Web und bieten Vervollständigungen an. Mit dem Nutzerfeedback – welche Vorschläge werden angeklickt? – verfeinern wir unser Modell. In diesem Fall ist es manchmal nützlich, zum Beispiel den ungefähren Aufenthaltsort des Nutzers genauer zu kennen, wie ihn die IP-Adresse oft verrät.

Von der EU lernen heißt Übersetzen lernen

Wie weit solche Ansätze der automatischen Sprachverarbeitung heute führen können, zeigt uns der Übersetzer Google Translate. Dessen Übersetzungen erfolgen nicht anhand von Regeln, die ein Programmierer vorgegeben hat. Das wäre die Microsoft-Methode für Firmen, die Software in Schachteln packen. Die Google-Methode funktioniert nach demselben Prinzip wie eben erläutert. Aus dem Web bekommt Google laufend Beispiele für Übersetzungen, etwa von der EU mit ihren 23 Arbeitssprachen, in die alle offiziellen Dokumente übersetzt werden. Diese Übersetzungen stammen von Menschen; Google lässt daraus Maschinen lernen.

Weil das alleine noch recht fehleranfällig ist, berücksichtigt Google wieder auch das Feedback von seinen Benutzern. Sie können für die Übersetzung einzelner Wörter oder Wortgruppen zwischen Alternativen wählen, eigene Korrekturen eingeben und die Übersetzung insgesamt bewerten:

Die Korrekturen und Bewertungen liefern Google auch hier eine Statistik zur Optimierung.

Verhaltensforschung ohne Privacy-Problem

Um solche Funktionen und Dienste realisieren zu können, muss Google seine Nutzer ein wenig beobachten. Google benötigt eine Aufzeichnung der Nutzerinteraktion über einen Nutzungskontext hinweg, der sich über eine Folge von Klicks (Nutzersicht) oder HTTP-Requests (Googlesicht) erstreckt. Informationen über den Nutzer als Person sind Google dabei egal, das beobachtete Nutzerverhalten liefert lediglich Datenpunkte für eine Statistik über die gesamte Nutzerpopulation. Google möchte an dieser Stelle nicht wissen, wer wir sind oder wofür wir uns interessieren, sondern welche Verhaltensweisen häufig und welche selten vorkommen.

Unerwünschte Nebenwirkungen, zum Beispiel das Erstellen persönlicher Rechtschreibprofile beim Dienstanbieter, sind nicht per se ausgeschlossen. Sie sind nur uninteressant und lassen sich durch mittlere Sorgfalt im Umgang mit Daten recht zuverlässig vermeiden. Unterwegs besteht noch das Risiko einer Datenverkehrsanalyse, aus der jemand trotz Verschlüsselung Rückschlüsse auf Eingaben ziehen könnte, aber das ist ein (kleines) inhärentes Risiko des Netzes, dafür kann Google nichts. Sollte so etwas als Angriffsszenario praktisch relevant werden, ließe es sich zudem technisch verhindern.

Google baut also Dienste, die mit implizitem Feedback aus dem statistischen Nutzerverhalten optimiert werden. In der nächsten Folge werden wir noch etwas tiefer in die Welt der lernenden Maschinen eintauchen. Es wird dann darum gehen, wie eine Maschine überhaupt lernen kann. Keine Angst, Formeln gibt es keine.

Datenkrake Google (2/7): Naive Modelle

[Inhalt – Teil 1 – Teil 2 – Teil 3 – Teil 4 – Teil 5 – Teil 6 (+Nachtrag) – Teil 7]

Im ersten Teil haben wir gesehen, dass Google häufig missverstanden wird, weil wir Metaphern aus unserer Erfahrungswelt auf Google anwenden und damit alles für erklärt halten. In Wirklichkeit funktionieren solche Metaphern aber nur für einige Oberflächenphänomene.

Google als Datenbank?

Ein vebreitetes Missverständnis betrifft die Sammlung, Speicherung und Verwendung personenbezogener Daten, landläufig als Nutzerprofile bezeichnet. Nutzerprofile kann sich jeder vorstellen, das sind, ganz klar, umfangreiche Datensätze in riesigen Datenbanken:

»Die Profile als solche sollen ja immer anonym sein, das heißt (sofern ich das richtig verstehe), dass das z. B. so aussieht:

- Profilnummer: 1337

- Interessen:

- Urlaubsziele: Toscana, Sizilien

- Hobbies: Arduino, Lockpicking

- Essen: Hamburger, Grießbrei

- …

Wenn jetzt jemand Werbung schalten möchte, geht derjenige zu Google und sagt: „Hey, Google, ich will für mein Grießbreiwettessen am Fuße des Ätna Werbung schalten. Bitte zeige also allen Grießbreiessern, die gerne nach Sizilien fahren oder dort wohnen, folgende Werbung:

‚[…]‘.“«(Kommentar von Steven Koenig alias Kreuvf auf heise.de)

An diesem Modell orientieren sich unsere Ängste und Befürchtungen. Doch repräsentiert dieses Modell überhaupt die Realität? Es wirkt plausibel für den, der mal eine herkömmliche Datenbank gesehen hat, oder darauf basierende primitive Versuche der Datensammlung durch Abfrage beim Nutzer:

»Wer einen neuen Account im Internet anlegt – egal ob für die E-Mail, ein Webforum oder eine neue Shoppingseite – erlebt stets ein mühsames Prozedere: Zuerst muss man sich einen Nutzernamen und ein Passwort auswählen. Danach wird man über drei Seiten nach Details vom Geburtsdatum bis zu persönlichen Vorlieben befragt und muss die Anmeldung am Schluss per E-Mail absegnen.«

(Zeit Online: Stoppt die Datenkraken!)

Als Missbrauchsszenario stellen wir uns dazu gerne einen schwunghaften Handel mit solchen Datensätzen vor.

Andersdenkende

Google hat sich jedoch das Think Different! von Apple geborgt und tut Dinge gerne auf eine ganz andere Art als der gewöhnliche IT-Spießer. Mit lächerlichem Spielkram wie Datenbanken hält sich Google nicht auf. Der Grund dafür ist nicht etwa, dass Google nach der Weltherrschaft strebt, sondern dass Google die Herrschaft über ein Stück Welt besitzt: über einen riesigen, verteilten Computer, der fast alle. veröffentlichten Informationen zu sehen bekommt. Und damit etwas anfangen soll, trotz des Kauderwelschs aus einigen Hundert Sprachen und Dialekten. Dabei helfen Datenbanken nicht, die brauchen zu viele Menschen, die sich um sie kümmern.

Im oben zitierten Heise-Forum fragt User flare—-*: »Ein Mensch arbeitet, vergnügt sich, informiert sich, macht Unsinn. Wie will google das vernünftig trennen?« Die Antwort auf diese Frage lautet: Das weiß Google selbst nicht so genau. Die Geschichte von Google begann mit einer ähnlichen Frage und derselben Antwort: Wie können wir aus einem schlecht organisierten Haufen unstrukturierter, redundanter, fehlerhafter und mehrsprachigerTextdaten relevante Informationen herausfiltern? Googles Antwort lautete von Beginn an: Indem wir uns nicht um spezifische, ausformulierte Regeln kümmern, wie es etwa die Linguisten tun, sondern den Umgang der Nutzerpopulation mit den Daten statistisch auswerten. PageRank war eine Keimzelle der Google-Philosophie, die darin besteht, einen Computer mit allen möglichen Daten zu füttern und ihn die Antworten auf Fragen selbst finden zu lassen. Google ist ein Computer wie ihn Science-Fiction-Autoren jahrzehntelang beschrieben haben.

Datenschützer werfen Exceptions

Cloud Computing hat deshalb für Google eine Doppelbedeutung. Neben der landläufigen Interpretation als Verlagerung der IT vom Endgerät ins Netz bedeutet Cloud Computing für Google auch Statistik in vieldimensionalen Datenwolken zur Beantwortung von Fragen, kurz: statistische Inferenz und maschinelles Lernen.