Warf man Internetkonzernen wie Google und Facebook einst vor allem vor, Datenkraken zu sein, hat heute de Algorithmenschelte den Spitzenplatz unter den Memen der Technikkritik übernommen. Die künstliche Intelligenz stehe kurz vor der Übernahme der Weltherrschaft, raunt es durch die Medien, und niemand verstehe so recht, was sich diese immer mächtiger werdenden Algorithmen dächten. Man müsse ihnen Zügel in Gestalt von Algorithmenethik und Not-Aus-Knöpfen anlegen, damit sie sich richtig entschieden, wenn sie etwa bei der Steuerung eines fahrerlosen Autos zwischen verschiedenen Unfallopfern zu wählen hätten.

Nun ist es gewiss nicht falsch, sich kritisch mit neuer Technik und ihren Anwendungen auseinanderzusetzen. Doch mittlerweile bekommt man manchmal den Eindruck, es sei legitim und notwendig, sich vor Algorithmen und künstlicher Intelligenz zu fürchten wie frühere Generationen vor dem Atomtod. Doch die gegenwärtigen Diskussionen sind geprägt von Missverständnissen, grandiosen Überschätzungen, Motiven aus der Science Fiction sowie modernen Legenden, die sich dank oberflächlicher Plausibilität durch ungeprüftes Nacherzählen verbreiten.

Eine dieser Legenden besagt, der Empfehlungsalgorithmus von YouTube fördere systematisch Schund und Schmutz und ziehe seine Nutzerinnen und Nutzer schnell und tief in extreme Filterblasen. Ich kann diese Erzählung aus eigener Erfahrung nicht nachvollziehen, denn meine persönlichen Empfehlungen sind an Harmlosigkeit kaum zu überbieten.

Ich habe freilich auch nicht die Methode angewandt, mit der die Empfehlungskritiker Belege für ihre These konstruieren: Getreu dem Axiom, dass stets nur die anderen als verstrahlte Manipulationsopfer in Frage kommen, während man selbst erleuchtet sei und alles durchschaue, betrachtet man einen hypothetischen Neunutzer ohne Vergangenheit, der YouTube zum ersten Mal nutzt und sogleich dessen Empfehlungen folgt. Das ist zwar offenkundiger Blödsinn, denn in dieser Situation kann auch das intelligenteste Empfehlungssystem nur raten, doch es liefert die gewünschte Geschichte. Mit Analysen, wie die Beobachtungen zustande kommen, hält man sich dabei nicht auf.

In diese Kerbe haut nun auch die Mozilla-Stiftung mit ihrer Kampagne YouTube Regrets, in der sie Geschichten verstörter Zuschauerinnen und Zuschauer erzählt und Google als Betreiber der Plattform angreift. Die Motivation bleibt unklar, doch konkurrieren Mozilla mit Firefox und Google mit Chrome erbittert um Anteile am Browsermarkt.

Im Zentrum der Kampagne stehen die Statements 28 anonymer YouTube-Zuschauer, die sich mehr oder minder entsetzt zeigen ob der Videos, die ihnen die Plattform empfahl. So empört sich Zeuge Nr. 3, Pferdesportfan, darüber, dass YouTube ihr oder ihm immer wieder Videos kopulierender Pferde anbiete, obgleich man an Pornographie gänzlich desinteressiert sei. Nr. 13 schaute sich Anita Sarkeesians „Tropes vs Women in Video Games“ an und sah sich daraufhin mit Videos des Gamergate-Mobs konfrontiert. Nr. 22 berichtet, nach dem Genuss von Gaming-Videos unvermittelt auf Bongs gestoßen zu sein und vermutet, der Algorithmus habe einen Witz aus einem der Videos aufgegriffen. In einigen Statements wird sogar von Kindern berichtet, die offenbar unbeaufsichtigt vor dem Google-Apparat saßen und die das Programm darin verstört habe.

So weit, so spießig. Als Beitrag zur Erhellung war Mozillas Kampagne vermutlich nicht gedacht, doch illustrieren die verwendeten Statements Missverständnisse und Denkfehler, die populistischer Algorithmenschelte wie dieser zugrunde liegen. Das größte Missverständnis: Es handle sich um komplizierte, geheimnisvolle Algorithmen, die anhand einer Unmenge von Daten unser Innerstes durchleuchteten, um unsere Interessen zu verstehen, und persönliche Empfehlungen für jede Einzelne von uns berechneten.

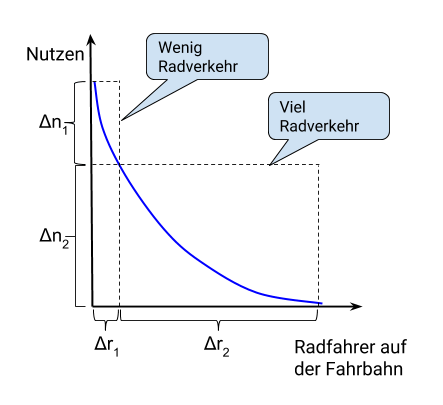

Tatsächlich verstehen wir Empfehlungssysteme gut. Sie berechnen abstrakte Kategorien – meist andere als ein Mensch bilden würde – in die sie sowohl Nutzer als auch Inhalte einordnen und geben die danach am besten passenden Kombinationen aus. Ihr Weltwissen beziehen sie dabei aus dem beobachteten und statistisch aggregierten Verhalten der Nutzerschar. Schauen sich also viele als Pferdeliebhaber eingestufte Nutzerinnen und Nutzer Filme von kopulierenden Pferden an, wird das Empfehlungssystem diese statistische Assoziation reproduzieren. Von Pferden oder von Kopulation versteht der Algorithmus dabei nicht das Geringste.

Überhaupt dürfte das Empfehlungssystem wenig oder gar keine Informationen über den Inhalt eines Videos berücksichtigen, denn solche sind trotz aller Fortschritte immer noch schwer zu ermitteln, zumal im YouTube-Maßstab, wo in jeder einzelnen Sekunde Videomaterial mit einer Gesamtlaufzeit von mehreren Stunden hochgeladen wird. Stattdessen wird das Empfehlungssystem vor allem oder ausschließlich mit Metadaten arbeiten: Titel und Beschreibungen, Kanäle, Likes und so weiter.

Von unserem Innersten, unseren Interessen versteht das Empfehlungssystem noch weniger als vom Inhalt der Videos, denn es sieht von uns nur das, was wir auf YouTube tun. Auf dieser Grundlage lassen sich keine wirklich persönlichen Empfehlungen geben, wie man sie vielleicht von engen Verwandten oder langjährigen Freunden erhielte. Vielmehr rät YouTube, was uns gefallen könnte, weil es andere mit ähnlichen Sehgewohnheiten angeschaut haben, statt aus seinem riesigen Angebot eine noch willkürlichere Zufallsauswahl zu präsentieren. Die einzige gerechtfertigte Erwartung an ein solches System ist die, dass es nach häufiger Nutzung Empfehlungen präsentiere, die im Mittel etwas weniger unpassend seien eine willkürliche Auswahl. Ganz unschuldig ist die Internetwirtschaft an Überschätzung ihrer Möglichkeiten allerdings nicht, nimmt sie doch den Mund gerne voll und preist den Output recht banaler Software selbst als personalisiert an.

Dem Missverständnis folgt ein Denkfehler, wenn man Algorithmen wie einem Empfehlungssystem Schutz vor Schund und Schmutz oder gar Moral abverlangt. Zum einen können sie dies bei weitem nicht leisten, denn sie betreiben letztlich nur automatisiert eine clevere Statistik, während sich an Fragen von Moral und Ethik Generationen von Philosophen und Theologen die Zähne ausgebissen haben, ohne endgültige Antworten geben zu können. Doch selbst wenn man auf Beschränkungen der Technik keine Rücksicht zu nehmen hätte, vielleicht gar Menschen an ihre Stelle setzte, blieben solche Entwurfsziele problematisch.

Wessen Moral soll „der Algorithmus“ durchsetzen? Ist es richtig, ist es notwendig, Menschen vor dem Anblick kopulierender Pferde zu schützen oder stellt vielleicht die Vermittlung biologischer Allgemeinbildung über die Fortpflanzung der Säugetiere ein höherrangiges Ziel dar? Sollen Empfehlungen Filterblasen verstärken, abschwächen oder ignorieren und gilt die Antwort gleichermaßen für feministische Filterblasen wie für jene des Gamergate-Mobs? Und was sollen wir aus der Tatsache schließen, dass mehrere Statements der Mozilla-Kampagne explizit sagen, man selbst habe den Schmutz natürlich als solchen erkannt, aber andere müssten doch sicher davor geschützt werden?

Das Internet ist ein Spiegel der Gesellschaft. Empfehlungssysteme geben ein Echo, teils auf das Sehverhalten einzelner Nutzerinnen und teils auf kollektives Verhalten. Wie sich diese Faktoren im Einzelnen mischen und ein bestimmtes Ergebnis hervorbringen, mag manchmal so schwer zu durchschauen sein wie die Akustik eines Konzertsaals für jemanden, der schon im Physikunterricht nicht aufgepasst hat. Dies ist jedoch kein Grund, Algorithmen zu verteufeln oder Unmögliches von ihnen zu verlangen. Es handelt sich nur um banale Computerprogramme.

Das heißt nicht, dass es nichts zu diskutieren gäbe. YouTube und andere Plattformen haben die Medienlandschaft verändert und damit auch die Art und Weise, wie gesellschaftliche Diskurse verlaufen. Doch wer die daraus resultierenden Fragen auf Algorithmenschelte verkürzt, setzt an der falschen Stelle an und verliert wichtige Aspekte aus dem Blick. Allen voran ist dies die Finanzierung durch Werbung, die nicht nur klassischen Medien Umsätze genommen hat – deswegen kämpften die Verlage so vehement für ein Leistungsschutzrecht, das ihnen Vor- und den neuen Konkurrenten Nachteile bescheren sollte – sondern auch die ökonomischen Anreize bestimmt, aus denen die Entwicklungs- und Optimierungsziele der Betreiber und damit Gestaltungsentscheidungen resultieren. Dass wirtschaftliche Abhängigkeit von der Werbung in der Programmgestaltung für eine Gratwanderung zwischen Krawall zur Publikumsbindung und Seichte zur Befriedigung der Werbekundenwünsche führt, kennen wir schon aus dem Privatfernsehen.

Algorithmen sind demgegenüber nur der verlängerte Arm des Unternehmens, das sie einsetzt. Sie bestimmen nicht die Richtung, sondern sie wirken als ausführendes Organ. Ihre Funktion folgt notwendig den Zielen und Prioritäten derer, die sie einsetzen. Wer sich an Algorithmen abarbeitet statt an Unternehmen und ihre Geschäftsmodellen, müsste folgerichtig angesichts des Volkswagen-Skandals, Verzeihung, der Dieselproblematik auch eine Motorenethik fordern. Doch darüber würden wir zu Recht lachen.

PS: Eine gute Vorstellung davon, wie Empfehlungssysteme funktionieren, vermittelt dieser Artikel: How The New York Times is Experimenting with Recommendation Algorithms.

(2019-10-24)

PPS: Eine neue Studie beschäftigt sich mit der Frage, ob man eine eventuelle Radikalisierung auf YouTube überhaupt „den Algorithmen“ zuschreiben kann.

(2019-10-25)